आर 2-डी 2 के बाद से आर्टिफिशियल इंटेलिजेंस ने एक लंबा सफर तय किया है। इन दिनों, अधिकांश मिलेनियल्स स्मार्ट जीपीएस सिस्टम के बिना खो जाएंगे। रोबोट पहले से ही युद्ध के मैदानों को नेविगेट कर रहे हैं, और ड्रोन जल्द ही हमारे दरवाजे पर अमेज़ॅन पैकेज वितरित कर सकते हैं।

सिरी जटिल समीकरणों को हल कर सकता है और आपको बता सकता है कि चावल कैसे पकाने हैं। उसने यह भी साबित कर दिया है कि वह हास्य की भावना के साथ सवालों के जवाब भी दे सकती है।

लेकिन ये सभी अग्रिम एआई दिशा देने वाले उपयोगकर्ता पर निर्भर करते हैं। क्या होगा अगर जीपीएस यूनिट्स ने फैसला किया कि वे ड्राई क्लीनर्स के पास नहीं जाना चाहते हैं, या इससे भी बदतर, सिरी ने फैसला किया कि वह आपके आस-पास बिना स्मार्ट हो सकती है?

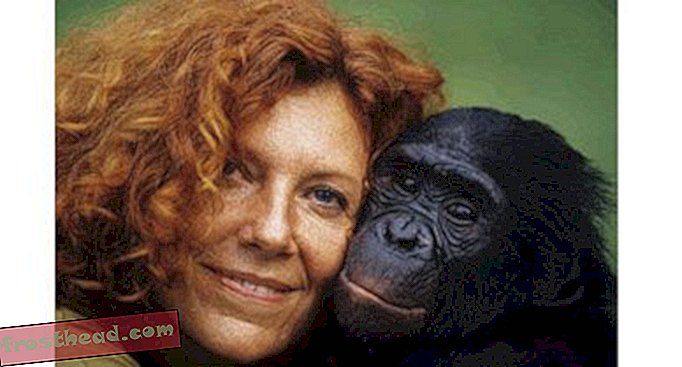

हमारा अंतिम आविष्कार: आर्टिफिशियल इंटेलिजेंस और मानव युग का अंत। "> हमारा अंतिम आविष्कार: कृत्रिम बुद्धिमत्ता और मानव युग का अंत। ">" इससे पहले कि हम सुपर-बुद्धिमान मशीनों के साथ ग्रह साझा करें, हमें उन्हें समझने के लिए एक विज्ञान विकसित करना होगा। अन्यथा, वे नियंत्रण लेंगे, "लेखक जेम्स बाराट अपनी नई किताब, हमारा अंतिम आविष्कार: आर्टिफिशियल इंटेलिजेंस और मानव युग का अंत " कहते हैं। (जेम्स बाराट के सौजन्य से)

हमारा अंतिम आविष्कार: कृत्रिम बुद्धिमत्ता और मानव युग का अंत। ">" इससे पहले कि हम सुपर-बुद्धिमान मशीनों के साथ ग्रह साझा करें, हमें उन्हें समझने के लिए एक विज्ञान विकसित करना होगा। अन्यथा, वे नियंत्रण लेंगे, "लेखक जेम्स बाराट अपनी नई किताब, हमारा अंतिम आविष्कार: आर्टिफिशियल इंटेलिजेंस और मानव युग का अंत " कहते हैं। (जेम्स बाराट के सौजन्य से) ये लेखक और डॉक्यूमेंट्री फिल्म निर्माता जेम्स बैराट के परिणामों का सिर्फ एक सबसे बड़ा उदाहरण हैं, उनकी नई किताब, हमारा अंतिम आविष्कार: कृत्रिम बुद्धिमत्ता और मानव युग का अंत ।

लंबे समय से पहले, बारात कहते हैं, कृत्रिम बुद्धिमत्ता- सिरी से ड्रोन और डेटा माइनिंग सिस्टम तक - उन्नयन के लिए मनुष्यों की तलाश करना बंद कर देंगे और अपने आप ही सुधार करना शुरू करेंगे। विज्ञान कथा के आर 2-डी 2 और एचएएल के विपरीत, हमारे भविष्य का एआई जरूरी अनुकूल नहीं होगा, वह कहते हैं: वे वास्तव में हो सकते हैं जो हमें नष्ट कर दें।

संक्षेप में, क्या आप अपने बड़े विचार की व्याख्या कर सकते हैं?

इस सदी में, वैज्ञानिक बुद्धि के साथ ऐसी मशीनें बनाएंगे जो बराबरी करती हैं और फिर हमारे खुद से आगे निकल जाती हैं। लेकिन इससे पहले कि हम ग्रह को सुपर-बुद्धिमान मशीनों के साथ साझा करें, हमें उन्हें समझने के लिए एक विज्ञान विकसित करना चाहिए। अन्यथा, वे नियंत्रण लेंगे। और नहीं, यह विज्ञान कथा नहीं है।

वैज्ञानिकों ने पहले से ही ऐसी मशीनें बनाई हैं जो शतरंज में मनुष्यों की तुलना में बेहतर हैं, खतरे में हैं!, नेविगेशन, डेटा माइनिंग, खोज, प्रमेय साबित करना और अनगिनत अन्य कार्य। आखिरकार, ऐसी मशीनें बनाई जाएंगी जो एआई रिसर्च में इंसानों से बेहतर हों

उस बिंदु पर, वे बहुत जल्दी अपनी क्षमताओं में सुधार करने में सक्षम होंगे। ये स्व-सुधार मशीनें उन लक्ष्यों का पीछा करेंगी, जिनके साथ वे बनाए गए हैं, चाहे वे अंतरिक्ष अन्वेषण हों, शतरंज खेल रहे हों या स्टॉक उठा रहे हों। सफल होने के लिए वे संसाधनों की तलाश करेंगे और खर्च करेंगे, यह ऊर्जा या पैसा हो। वे विफलता मोड से बचने की तलाश करेंगे, जैसे स्विच बंद या अनप्लग्ड। संक्षेप में, वे आत्म-संरक्षण और संसाधन अधिग्रहण सहित ड्राइव विकसित करेंगे-हमारे अपने जैसे बहुत ड्राइव। वे भीख माँगने, उधार लेने, चोरी करने और जो कुछ भी ज़रूरत है उसे प्राप्त करने में संकोच नहीं करेंगे।

इस विषय में आपकी रुचि कैसे हुई?

मैं एक डॉक्यूमेंट्री फिल्म निर्माता हूं। 2000 में, मैंने उपन्यास और फिल्म, 2001: ए स्पेस ओडिसी के निर्माण के बारे में एक टीएलसी फिल्म के लिए आविष्कारक रे कुर्ज़वील, रोबोटिस्ट रॉडनी ब्रूक्स और विज्ञान-फाई किंवदंती आर्थर सी। क्लार्क का साक्षात्कार लिया । साक्षात्कारों ने हैल 9000 और पुरुषवादी कंप्यूटर के विचार का पता लगाया। कुर्ज़वील की पुस्तकों ने एआई के भविष्य को एक शानदार "विलक्षणता" के रूप में चित्रित किया है, एक ऐसी अवधि जिसमें तकनीकी विकास उन्हें समझने के लिए मनुष्यों की क्षमता को आगे बढ़ाता है। फिर भी उन्होंने एआई से उभरने वाली केवल अच्छी चीजों का अनुमान लगाया जो कि मैच के लिए काफी मजबूत है और फिर मानव बुद्धि को पार कर जाती है। वह भविष्यवाणी करता है कि हम बीमारी और उम्र बढ़ने को हराने के लिए अपने शरीर की कोशिकाओं को दोबारा बनाने में सक्षम होंगे। हम लाल रक्त कोशिकाओं की तुलना में अधिक ऑक्सीजन देने वाले नैनोबॉट्स के साथ सुपर धीरज विकसित करेंगे। हम अपने दिमाग को कंप्यूटर प्रत्यारोपण से सुपरचार्ज करेंगे ताकि हम अधीक्षक बन जाएँ। और हम अपने दिमाग को हमारे वर्तमान "वेटवेयर" की तुलना में अधिक टिकाऊ माध्यम में पोर्ट करेंगे और अगर हम चाहते हैं तो हमेशा के लिए जीवित रहेंगे। ब्रूक्स आशावादी थे, जोर देकर कहा कि एआई-एन्हांस्ड रोबोट सहयोगी होंगे, खतरे नहीं।

दूसरी ओर, वैज्ञानिक-लेखक-लेखक क्लार्क निराशावादी थे। उसने मुझे बताया कि बुद्धिमत्ता जीत जाएगी, और मनुष्य संभवतः सुपर-बुद्धिमान मशीनों के साथ अस्तित्व के लिए प्रतिस्पर्धा करेंगे। वह इस बारे में विशिष्ट नहीं था कि जब हम ग्रह को सुपर-इंटेलिजेंट मशीनों के साथ साझा करेंगे, तो क्या होगा, लेकिन उन्हें लगा कि यह मानव जाति के लिए एक संघर्ष होगा जिसे हम जीतेंगे।

एआई के बारे में मैंने जो कुछ भी सोचा था, उसके खिलाफ गया, इसलिए मैंने कृत्रिम बुद्धिमत्ता विशेषज्ञों का साक्षात्कार करना शुरू किया।

आपके विचार का समर्थन करने के लिए आपके पास क्या सबूत हैं?

उन्नत कृत्रिम बुद्धिमत्ता एक दोहरे उपयोग की तकनीक है, जैसे कि परमाणु विखंडन, जो कि अच्छे या बड़े नुकसान के लिए सक्षम है। हम सिर्फ नुकसान देखना शुरू कर रहे हैं।

एनएसए गोपनीयता घोटाला के बारे में आया क्योंकि एनएसए ने बहुत परिष्कृत डेटा-खनन उपकरण विकसित किए। एजेंसी ने अपनी शक्ति का इस्तेमाल लाखों फोन कॉल और इंटरनेट की संपूर्णता-सभी ईमेल के मेटाडेटा को गिराने के लिए किया। डेटा-माइनिंग एआई की शक्ति से प्रेरित होकर, एक एजेंसी ने संविधान की रक्षा करने के बजाय उसे गाली दी। उन्होंने जिम्मेदारी से उपयोग करने के लिए उनके लिए बहुत शक्तिशाली उपकरण विकसित किए।

आज, पाश में मनुष्यों के बिना उन्नत AI- मानव-हत्यारों द्वारा संचालित पूरी तरह से स्वायत्त हत्यारे ड्रोन और युद्धक्षेत्र रोबोट बनाने के बारे में एक और नैतिक लड़ाई चल रही है। यह रक्षा विभाग और ड्रोन और रोबोट निर्माताओं के बीच पक रहा है जो डीओडी द्वारा भुगतान किए जाते हैं, और जो लोग सोचते हैं कि यह बुद्धिमान हत्या मशीन बनाने के लिए मूर्खतापूर्ण और अनैतिक है। स्वायत्त ड्रोन और युद्धक्षेत्र रोबोट के पक्ष में तर्क देते हैं कि वे अधिक नैतिक होंगे- यानी कम भावनात्मक, बेहतर लक्ष्य करेंगे और मानव ऑपरेटरों की तुलना में अधिक अनुशासित होंगे। मनुष्यों को पाश से बाहर निकालने के खिलाफ वे ड्रोन के नागरिकों की हत्या के दयनीय इतिहास को देख रहे हैं, और बाहरी हत्याओं में शामिल हैं। जब एक रोबोट मारता है तो नैतिक दोषी को किसके कंधे पर रखना चाहिए? रोबोट निर्माता, रोबोट उपयोगकर्ता, या कोई नहीं? दोस्त को दुश्मन से बताने की तकनीकी अड़चन के बारे में कभी नहीं।

लंबी अवधि में, जैसा कि मेरी पुस्तक के विशेषज्ञों का तर्क है , मानव-स्तर की खुफिया जानकारी प्राप्त करने वाले एआई को आसानी से नियंत्रित नहीं किया जाएगा; दुर्भाग्य से, सुपर-इंटेलिजेंस परोपकार नहीं करता है। MIRI के AI सिद्धांतकार Eliezer Yudkowsky [मशीन इंटेलिजेंस रिसर्च इंस्टीट्यूट] इसे कहते हैं, "AI आपको प्यार नहीं करता है, और न ही यह आपसे नफरत करता है, लेकिन आप उन परमाणुओं से बने हैं जो इसे किसी और चीज़ के लिए उपयोग कर सकते हैं।" एक मशीन में बनाया जा सकता है, फिर हम सुपर-इंटेलिजेंट साइकोपैथ्स बनाएंगे, बिना नैतिक कम्पास के जीव, और हम लंबे समय तक उनके स्वामी नहीं रहेंगे।

आपकी सोच में नया क्या है?

अमेरिकी कंप्यूटर वैज्ञानिक बिल जॉय और MIRI के रूप में अलग-अलग व्यक्तियों और समूहों ने लंबे समय से चेतावनी दी है कि हमें उन मशीनों से डरना बहुत है जिनकी बुद्धि हमारे खुद को ग्रहण करती है। हमारे अंतिम आविष्कार में, मैं तर्क देता हूं कि मानव विकास स्तर की बुद्धिमत्ता के लिए AI का भी दुरुपयोग किया जाएगा। आज और उस दिन के बीच जब वैज्ञानिक मानव-स्तरीय बुद्धिमत्ता का निर्माण करते हैं, हमारे पास AI से संबंधित गलतियाँ और आपराधिक अनुप्रयोग होंगे।

क्यों अधिक नहीं किया गया है, या, AI को हमें चालू करने से रोकने के लिए क्या किया जा रहा है?

एक कारण नहीं है, लेकिन कई हैं। कुछ विशेषज्ञों का मानना है कि हम मानव-स्तर की कृत्रिम बुद्धिमत्ता बनाने और इसके जोखिमों के बारे में चिंता करने से परे हैं। कई AI निर्माता डिफेंस एडवांस्ड रिसर्च प्रोजेक्ट्स एजेंसी [DARPA] के साथ कॉन्ट्रैक्ट जीतते हैं और वे उन मुद्दों को नहीं उठाना चाहते हैं जिन्हें वे राजनीतिक मानते हैं। सामान्य बियास एक संज्ञानात्मक पूर्वाग्रह है जो लोगों को आपदाओं और आपदाओं को प्रतिक्रिया करने से रोकता है - यह निश्चित रूप से इसका हिस्सा है। लेकिन बहुत सारे AI निर्माता कुछ कर रहे हैं। उन वैज्ञानिकों की जाँच करें जो MIRI को सलाह देते हैं। एक बार, उन्नत AI के खतरों को मुख्यधारा के संवाद में शामिल करने के बाद और भी बहुत कुछ शामिल हो जाएगा।

क्या आप एक पल का वर्णन कर सकते हैं जब आप जानते थे कि यह बड़ा था?

हम मनुष्य भविष्य को आगे बढ़ाते हैं, क्योंकि हम ग्रह पर सबसे तेज या सबसे मजबूत प्राणी हैं, लेकिन क्योंकि हम सबसे चतुर हैं। जब हम अपने आप से अधिक चालाक जीवों के साथ ग्रह साझा करते हैं, तो वे भविष्य को आगे बढ़ाएंगे। जब मैंने इस विचार को समझा, तो मुझे लगा कि मैं अपने समय के सबसे महत्वपूर्ण प्रश्न के बारे में लिख रहा हूं।

हर बड़े विचारक के पूर्ववर्ती होते हैं जिनका काम उनकी खोज के लिए महत्वपूर्ण था। आपको अपने विचार बनाने की नींव किसने दी?

एआई जोखिम विश्लेषण की नींव गणितज्ञ आईजे गुड, विज्ञान कथा लेखक वर्नोर विंज और एआई डेवलपर स्टीव ओमोहुंड्रो सहित अन्य द्वारा विकसित की गई थी। आज, MIRI और ऑक्सफ़ोर्ड के फ्यूचर ऑफ़ ह्यूमैनिटी इंस्टिट्यूट इस समस्या को दूर करने में लगभग अकेले हैं। हमारे अंतिम आविष्कार में इन विचारकों को स्वीकार करने वाले लगभग 30 पृष्ठ हैं।

अपने विचार पर शोध और विकास करने में, उच्च बिंदु क्या रहा है? और निम्न बिंदु?

उच्च बिंदु हमारे अंतिम आविष्कार, और एआई निर्माताओं और सिद्धांतकारों के साथ मेरी चल रही बातचीत लिख रहे थे। एआई कार्यक्रम करने वाले लोग सुरक्षा के मुद्दों के बारे में जानते हैं और सुरक्षा उपायों के साथ आने में मदद करना चाहते हैं। उदाहरण के लिए, MIRI "अनुकूल" AI बनाने पर काम कर रहा है

कंप्यूटर वैज्ञानिक और सिद्धांतकार स्टीव ओमोहुंड्रो ने "मचान" दृष्टिकोण की वकालत की है, जिसमें एआई की अगली पीढ़ी को यह सुनिश्चित करने में मदद करता है कि यह भी सुरक्षित है। फिर वह एआई भी ऐसा ही करता है। मुझे लगता है कि AI- निर्माताओं को सुरक्षा के बारे में विचारों को साझा करने के लिए एक सार्वजनिक-निजी साझेदारी का निर्माण करना है - अंतर्राष्ट्रीय परमाणु ऊर्जा एजेंसी जैसी कुछ, लेकिन निगमों के साथ साझेदारी में। कम अंक? यह महसूस करते हुए कि हथियार बनाने के लिए सबसे अच्छी, सबसे उन्नत एआई तकनीक का उपयोग किया जाएगा। और वे हथियार आखिरकार हमारे खिलाफ हो जाएंगे।

दो या तीन लोगों को आपके तर्क का खंडन करने की कोशिश करने की सबसे अधिक संभावना है? क्यूं कर?

आविष्कारक रे कुर्ज़वेइल उन्नत प्रौद्योगिकियों के लिए मुख्य माफी देने वाला है। उनके साथ मेरे दो साक्षात्कारों में, उन्होंने दावा किया कि हम संज्ञानात्मक संवर्द्धन के माध्यम से एआई प्रौद्योगिकियों के साथ पिघलेंगे। कुर्ज़वील और मोटे तौर पर ट्रांसह्यूमनिस्ट और विलक्षणवादी कहे जाने वाले लोग एआई और अंततः कृत्रिम सामान्य बुद्धि और उससे परे के बारे में सोचते हैं। उदाहरण के लिए, कंप्यूटर प्रत्यारोपण हमारे दिमाग की गति और समग्र क्षमताओं को बढ़ाएगा। आखिरकार, हम अपनी बुद्धिमत्ता और चेतना को कंप्यूटरों में पहुंचाने के लिए तकनीक विकसित करेंगे। तब सुपर-इंटेलिजेंस कम से कम आंशिक रूप से मानव होगा, जो यह सुनिश्चित करेगा कि सुपर-इंटेलिजेंस "सुरक्षित" था।

कई कारणों से, मैं इस दृष्टिकोण का प्रशंसक नहीं हूं। परेशानी यह है कि हम इंसान मज़बूती से सुरक्षित नहीं हैं, और लगता है कि सुपर-इंटेलिजेंट इंसान भी नहीं होंगे। हमें इस बात का कोई अंदाजा नहीं है कि इंसान की नैतिकता का क्या होता है क्योंकि उनकी बुद्धिमत्ता को बढ़ाया जाता है। हमारे पास आक्रामकता का एक जैविक आधार है जिसमें मशीनों की कमी है। सुपर-इंटेलिजेंस बहुत अच्छी तरह से एक आक्रामकता गुणक हो सकता है।

इस विचार से कौन सबसे अधिक प्रभावित होगा?

सुपर बुद्धिमान मशीनों के अनियमित विकास से ग्रह पर सभी को बहुत डर है। अभी एक खुफिया दौड़ चल रही है। AGI हासिल करना Google, IBM और कई छोटी कंपनियों जैसे विकरियस और डीप थॉट्स के साथ-साथ DARPA, NSA और सरकारों और विदेशों की कंपनियों के लिए जॉब नंबर वन है। लाभ उस दौड़ के लिए मुख्य प्रेरणा है। एक संभावित लक्ष्य की कल्पना करें: एक कंप्यूटर की कीमत पर एक आभासी मानव मस्तिष्क। यह इतिहास में सबसे आकर्षक वस्तु होगी। फार्मास्युटिकल डेवलपमेंट, कैंसर रिसर्च, हथियारों के विकास और बहुत कुछ पर 24/7 काम करने वाले हजारों पीएचडी गुणवत्ता वाले दिमाग के बैंकों की कल्पना करें। कौन उस तकनीक को खरीदना नहीं चाहेगा?

इस बीच, 56 राष्ट्र युद्धक्षेत्र रोबोट विकसित कर रहे हैं, और ड्राइव उन्हें, और ड्रोन, स्वायत्त बनाने के लिए है। वे ऐसी मशीनें होंगी जो इंसानों को मार डालती हैं। प्रभावित राष्ट्रों को स्वायत्त ड्रोन और युद्धक्षेत्र रोबोट द्वारा सबसे अधिक चोट पहुंचाई जाएगी। प्रारंभ में, केवल अमीर देश ही स्वायत्त मारने वाले बॉट का वहन करने में सक्षम होंगे, इसलिए धनी राष्ट्र इन हथियारों को कमजोर देशों के मानव सैनिकों के खिलाफ लहराएंगे।

जैसा कि हम जानते हैं कि यह जीवन को कैसे बदल सकता है?

कल्पना करें: एक दशक में कम से कम, एक आधा दर्जन कंपनियां और राष्ट्र कंप्यूटरों का क्षेत्र बनाते हैं जो मानव बुद्धि को प्रतिद्वंद्वी या पार करते हैं। कल्पना कीजिए कि जब वे कंप्यूटर स्मार्ट कंप्यूटर प्रोग्रामिंग करने में माहिर हो जाते हैं तो क्या होता है। जल्द ही हम हजारों या लाखों बार मशीनों को ग्रह से साझा कर रहे हैं जो हम हैं। और, सभी समय, इस प्रौद्योगिकी के प्रत्येक पीढ़ी को हथियारबद्ध किया जाएगा। अनियमित, यह विनाशकारी होगा।

अनुत्तरित क्या प्रश्न छोड़ दिए जाते हैं?

समाधान की। स्पष्ट समाधान मशीनों को एक नैतिक अर्थ देना होगा जो उन्हें मानव जीवन और संपत्ति का मूल्य देता है। लेकिन एक मशीन में प्रोग्रामिंग नैतिकता बहुत कठिन हो जाती है। नैतिक मानदंड संस्कृति से संस्कृति में भिन्न होते हैं, वे समय के साथ बदलते हैं, और वे प्रासंगिक हैं। यदि हम मनुष्य जीवन शुरू होने पर सहमत नहीं हो सकते हैं, तो हम जीवन की रक्षा करने के लिए एक मशीन कैसे बता सकते हैं? क्या हम वास्तव में सुरक्षित होना चाहते हैं , या क्या हम वास्तव में मुक्त होना चाहते हैं ? हम इसे पूरे दिन बहस कर सकते हैं और आम सहमति तक नहीं पहुंच सकते हैं, इसलिए हम संभवतः इसे कैसे कर सकते हैं?

हम भी, जैसा कि मैंने पहले उल्लेख किया है, एआई डेवलपर्स को एक साथ लाने की आवश्यकता है। 1970 के दशक में, पुनः संयोजक डीएनए शोधकर्ताओं ने अनुसंधान को निलंबित करने और प्रशांत ग्रोव, कैलिफोर्निया में असिलोमर में एक सम्मेलन के लिए एक साथ आने का फैसला किया। प्रगति में आनुवंशिक कार्यों के साथ पर्यावरण को दूषित करने के डर से उन्होंने "अपने जूतों पर डीएनए को ट्रैक न करें" जैसे बुनियादी सुरक्षा प्रोटोकॉल विकसित किए। "Asilomar दिशानिर्देश" की वजह से, दुनिया आनुवंशिक रूप से संशोधित फसलों से लाभान्वित होती है, और जीन थेरेपी आशाजनक लगती है। अब तक हम जानते हैं, दुर्घटनाओं से बचा गया था। यह एआई के लिए एक असिलोमर सम्मेलन का समय है

रास्ते में क्या खड़ा है?

एक विशाल आर्थिक पवन एक कंप्यूटर की कीमत पर उन्नत एआई मानव-स्तरीय खुफिया के विकास को प्रेरित करती है जो इतिहास में सबसे कमोडिटी होगी। Google और IBM अपने रहस्यों को जनता या प्रतिस्पर्धियों के साथ साझा नहीं करना चाहेंगे। रक्षा विभाग चीन और इज़राइल के लिए अपनी प्रयोगशालाओं को खोलना नहीं चाहेगा, और इसके विपरीत। सार्वजनिक जागरूकता को सुरक्षा सुनिश्चित करने के लिए डिज़ाइन किए गए खुलेपन और सार्वजनिक-निजी भागीदारी के प्रति नीति को आगे बढ़ाना है।

आपके लिए आगे क्या है?

मैं एक डॉक्यूमेंट्री फिल्म निर्माता हूं, इसलिए निश्चित रूप से मैं हमारे अंतिम आविष्कार के एक फिल्म संस्करण के बारे में सोच रहा हूं।